大模型电脑应该选择哪种显卡?选择显卡时需要考虑哪些因素?

- 电脑知识

- 2025-09-14

- 20

- 更新:2025-08-29 10:14:33

大模型电脑应该选择哪种显卡?选择显卡时需要考虑哪些因素?

在当今科技飞速发展的时代,深度学习和人工智能领域正逐渐渗透到我们生活的各个方面。进行大模型计算时,选择合适的显卡(通常指图形处理单元GPU)至关重要。本文将为您详细探讨,在构建用于大模型运算的电脑时,应该如何选择显卡,并列举在选择过程中需要考虑的因素。

为什么显卡对于大模型计算如此重要?

在深度学习和人工智能领域中,大模型通常指的是拥有数百万甚至数十亿参数的神经网络模型。这些模型的训练和推理过程需要大量的矩阵计算,而GPU由于其高度并行化的架构,可以高效地处理这类计算任务,因此成为运行大模型的首选硬件。

核心显卡选择标准

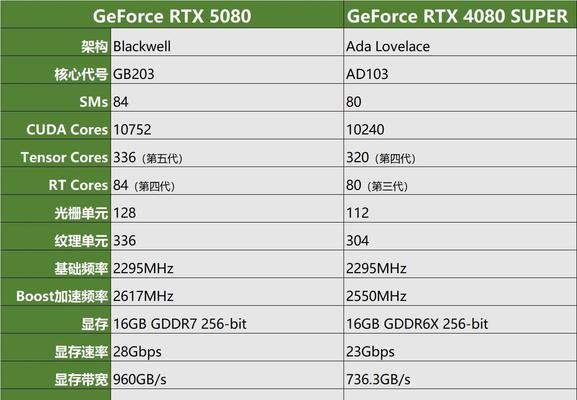

计算能力

核心显卡选择的第一标准是其计算能力。计算能力通常用“TFLOPS”(每秒万亿次浮点运算)来衡量。对于大模型计算而言,选择拥有较高TFLOPS的显卡可以显著提高计算效率。

内存容量

大模型需要大量的内存来存储其参数和中间计算结果。在选择显卡时,应考虑其显存(VRAM)的大小。显存容量不足会导致运行时发生内存溢出错误,影响模型训练的进度。

源于深度学习的优化

除了基础的图形处理能力外,一些显卡针对深度学习进行了专门优化,例如NVIDIA的TensorCore技术。这种优化可以进一步提升深度学习相关的计算速度和效率。

选择显卡时的额外考量因素

与软件的兼容性

选择显卡时,您需要确认所使用的深度学习框架(如TensorFlow或PyTorch)与显卡驱动程序的兼容性。某些框架可能对特定品牌的显卡优化得更好。

能耗与散热

显卡在运行时会产生大量热量,因此必须确保您的系统具有高效的散热系统。同时,考虑到能耗问题,尤其是在需要构建多卡系统的环境下,能耗成本不容忽视。

性价比考量

考虑到显卡的价格,性价比是一个重要的因素。在满足计算需求的前提下,选择性能相对均衡、价格合理的显卡会是一个经济有效的选择。

可扩展性

构建大模型电脑时,考虑到未来可能对模型规模的扩展,选择可扩展性强的显卡,如支持多卡互联技术的显卡,将有助于未来升级。

实用技巧与建议

在选择显卡时,您可以依据以下实用技巧和建议进行操作:

1.确认模型需求:了解您的模型对计算能力、内存大小的具体需求。

2.查阅评测资料:参考各大论坛、技术社区以及专业评测机构发布的相关显卡测试报告。

3.关注市场价格动态:通过比较不同品牌、型号的显卡价格,寻找性价比更高的产品。

4.购买建议:考虑售后服务和保修政策,选择信誉良好的品牌。

常见问题解答

1.为什么NVIDIA的显卡在大模型计算中更受欢迎?

NVIDIA的显卡特别在其CUDA架构上对深度学习进行了优化。CUDA技术允许开发者直接利用GPU进行通用并行计算,极大地提高了在神经网络训练和推理时的性能。

2.使用多卡并行计算时应注意什么?

使用多卡时,需要确保系统主板支持多卡互联技术(如NVIDIA的NVLink或AMD的InfinityFabric),以及显卡之间性能尽量一致,以避免瓶颈效应。

3.如何评估显卡的性能?

可以通过运行特定的性能测试软件(如TimeSpy)以及实际在一些开源大模型上进行测试,来评估显卡的性能。

4.大模型计算通常需要多少显存?

这取决于模型的复杂度和批量大小,但一般来说,至少需要8GB以上的显存。对于更复杂的模型,可能需要16GB甚至32GB以上的显存。

5.如何判断显卡是否支持深度学习框架?

检查深度学习框架的官方文档或GitHub页面,通常会列出支持的显卡型号和驱动版本要求。

通过以上内容,您应该已经对大模型电脑应该选择哪种显卡有了一个清晰的认识,并掌握了选择显卡时需要考虑的各个因素。在实施过程中,综合考量这些因素将有助于您更有效地搭建适合大模型运算的计算平台。